что делать с дублями страниц

Как быстро найти и удалить все дубли страниц на сайте: 8 способов + лайфхак

Дубли — это страницы с одинаковым контентом. Они могут появиться при автогенерации, некорректных настройках, вследствие изменения структуры сайта или при неправильной кластеризации. Дубликаты негативно влияют на SEO-продвижение, так как поисковые системы хуже ранжируют страницы с похожим контентом. Кроме того, большое количество слабых, несодержательных или пустых страниц понижают оценку всего сайта. Поэтому важно своевременно отслеживать и устранять подобные проблемы.

В данной статье подробно рассмотрим, как найти и удалить дубли, а также предотвратить их появление.

Виды дублей

Дубликаты бывают 3-х видов:

Зачастую при анализе обращают внимание лишь на полные совпадения, но не стоит забывать про частичные и смысловые, так как к ним поисковики тоже относятся критично.

Полные

Полные дубли ухудшают хостовые факторы всего сайта и осложняют его продвижение в ТОП, поэтому от них нужно избавиться сразу после обнаружения.

Избавиться от полных дубликатов можно, поставив редирект, убрав ошибку программно или закрыв документы от индексации.

Частичные

Частичные дубликаты оказывают не такое сильное влияние на сайт, как полные. Однако если их много — это ухудшает ранжирование веб-ресурса. Кроме того, они могут мешать продвижению и по конкретным ключевым запросам. Разберем в каких случаях они возникают.

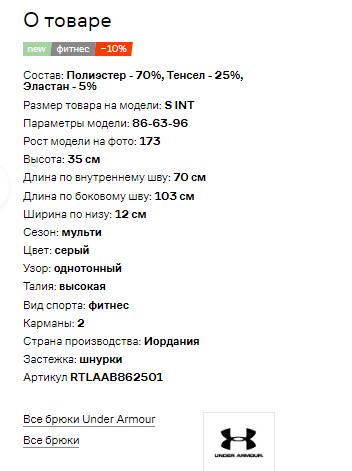

Характеристики в карточке товара

Нередко, переключаясь на вкладку в товарной карточке, например, на отзывы, можно увидеть, как это меняет URL-адрес. При этом большая часть контента страницы остаётся прежней, что создает дубль.

Пагинация

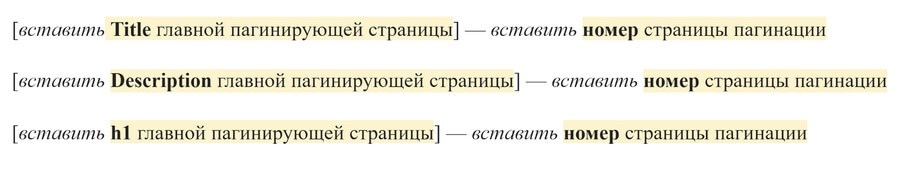

Если CMS неправильно настроена, переход на следующую страницу в категории меняет URL, но не изменяет Title и Description. В итоге получается несколько разных ссылок с одинаковыми мета-тегами:

Такие URL-адреса поисковики индексируют как отдельные документы. Чтобы избежать дублирования, проверьте техническую реализацию вывода товаров и автогенерации.

Также на каждой странице пагинации необходимо указать каноническую страницу, которая будет считаться главной. Как указать этот атрибут, будет рассмотрено ниже.

Подстановка контента

Часто для повышения видимости по запросам с указанием города в шапку сайта добавляют выбор региона. При нажатии которого на странице меняется номер телефона. Бывают случаи, когда в адрес добавляется аргумент, например «wt_city_by_default=..». В результате, у каждой страницы появляется несколько одинаковых версий с разными ссылками. Не допускайте подобной генерации или используйте 301 редирект.

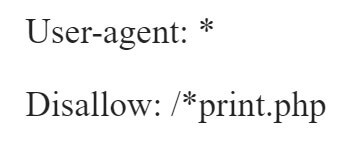

Версия для печати

Версии для печати полностью копируют контент и нужны для преобразования формата содержимого. Пример:

Поэтому необходимо закрывать их от индексации в robots.txt.

Смысловые

Смысловые дубли — это статьи, написанные под запросы из одного кластера. Чтобы их обнаружить, нужно воспользоваться результатом парсинга сайта, выполненного, например, программой Screaming Frog. Затем скопировать заголовки всех статей и добавить их в любой Hard-кластеризатор с порогом группировки 3,4. Если несколько статей попали в один кластер – оставьте наиболее качественную, а с остальных поставьте 301 редирект.

Варианты устранения дубликатов

При дублировании важно не только избавиться от копий, но и предотвратить появление новых.

Физическое удаление

Самым простым способом было бы удалить повторяющиеся страницы вручную. Однако перед удалением нужно учитывать несколько важных моментов:

Настройка 301 редиректа

Создание канонической страницы

Указав каноническую страницу, вы показываете поисковым системам, какой документ считать основным. Этот способ используется для того, чтобы показать, какую страницу нужно индексировать при пагинации, сортировке, попадании в URL GET-параметров и UTM-меток. Для этого на всех дублях в теге прописывается следующая строчка со ссылкой на оригинальную страницу:

Например, на странице пагинации главной должна считаться только одна страница: первая или «Показать все». На остальных необходимо прописать атрибут rel=»canonical», также можно использовать теги rel=prev/next.

Для второй и последующей:

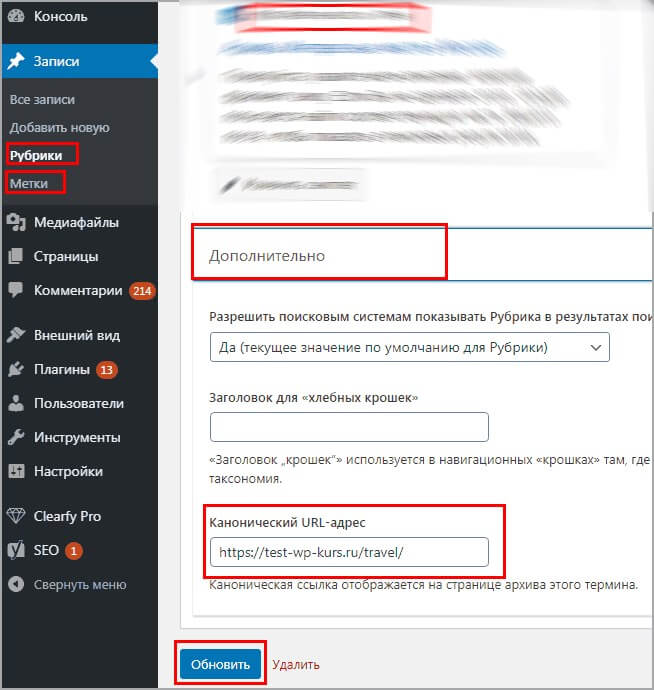

Для решения этой задачи на сайтах WordPress используйте плагины Yoast SEO или All in One SEO Pack. Чтобы все заработало просто зайдите в настройки плагина и отметьте пункт «Канонические URL».

Запрет индексации файла Robots.txt

Файле robots.txt — это своеобразная инструкция по индексации для поисковиков. Она подойдёт, чтобы запретить индексацию служебных страниц и дублей.

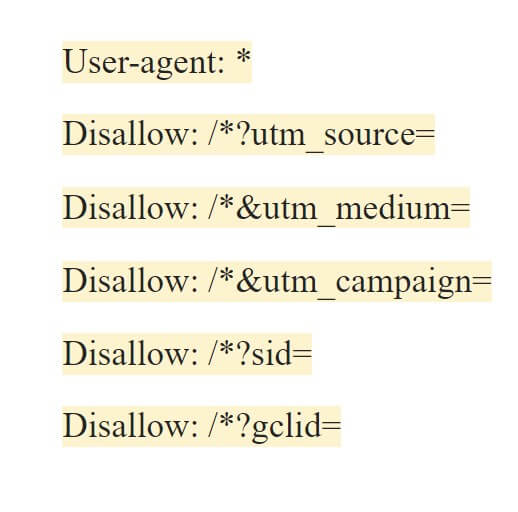

Для этого нужно воспользоваться директивой Disallow, которая запрещает поисковому роботу индексацию.

Disallow: /dir/ – директория dir запрещена для индексации

Disallow: /dir – директория dir и все вложенные документы запрещены для индексации

Disallow: *XXX – все страницы, в URL которых встречается набор символов XXX, запрещены для индексации.

Внимательно следите за тем какие директивы вы прописываете в robots. П ри некорректном написании можно заблокировать не те разделы либо вовсе закрыть сайт от поисковых систем.

Запрет индексировать страницы действует для всех роботов. Но каждый из них реагирует на директиву Disallow по-разному: Яндекс со временем удалит из индекса запрещенные страницы, а Google может проигнорировать правило, если на данный документ ведут ссылки.

Причины возникновения

Обычно при взгляде на URL-адрес можно сразу определить причину возникновения дубля. Но иногда нужен более детальный анализ и знание особенностей CMS. Ниже приведены 6 основных причин, почему они могут появляться:

Некоторые ошибки могут появиться и по другим причинам, например, если не указан редирект со старой страницы на новую или из-за особенностей конкретных скриптов и плагинов. С каждой такой проблемой нужно разбираться индивидуально.

Отдельным пунктом можно выделить страницы, дублирующиеся по смыслу. Такая ошибка часто встречается при неправильной разгруппировке. Подробнее о том как ее не сделать читайте по ссылке.

Как дубликаты влияют на позиции сайта

Дубли существенно затрудняют SEO- продвижение и могут стать препятствием для выхода запросов в ТОП поисковой выдачи.

Чем же они так опасны:

Инструменты для поиска

Как найти дублирующие ся документы? Это можно сделать с помощью программ и онлайн-сервисов. Часть из них платные, другие – бесплатные, некоторые – условно-бесплатные (с пробной версией или ограниченным функционалом).

Яндекс.Вебмастер

Чтобы посмотреть наличие дубликатов в панели Яндекса, необходимо:

Страницы исключаются из индекса по разным причинам, в том числе из-за повторяющегося контента. Обычно конкретная причина прописана под ссылкой.

Netpeak Spider

Netpeak Spider – платная программа с 14-дневной пробной версией. Если провести поиск по заданному сайту, программа покажет все найденные ошибки и дубликаты.

Бесплатным аналогом этих программ является Xenu, где можно проанализировать даже не проиндексированный сайт.

При сканировании программа найдет повторяющиеся заголовки и мета-описания.

Screaming Frog Seo Spider

Screaming Frog Seo Spider является условно-бесплатной программой. До 500 ссылок можно проверить бесплатно, после чего понадобится платная версия. Наличие дублей программа определяет так же, как и Xenu, но быстрее и эффективнее. Если нет денег на покупку рабочий ключ можно найти в сети.

Сервис-лайфхак

Для тех кто не хочет осваивать программы, рекомендую воспользоваться техническим анализом от Wizard.Sape. Аудит делается в автоматическом режиме в среднем за 2-4 часа. Цена вопроса — 690 рублей. В течении 30 дней бесплатно можно провести повторную проверку.

Помимо дублированного контента и мета-тегов инструмент выдает много полезной информации:

Вывод

Полные и частичные дубли значительно осложняют продвижение сайта. Поэтому обязательно проверяйте ресурс на дубликаты, как сгенерированные, так и смысловые и применяйте описанные в статье методы для их устранения.

Дубли сайта: как бороться с повторяющимся контентом

Дубли – это не просто повторы на вашем сайте. Это причина целого ряда проблем, которые могут обнаружиться далеко не сразу. В чем опасность дублированного контента, почему к нему нужно относится весьма настороженно? В статье найдете ответы на эти вопросы, а также узнаете, что может случится, если не контролировать дубли вообще. Расскажу, как можно выявить дубли вручную и автоматически – я познакомлю вас с самыми эффективными инструментами для решения этой задачи.

В чем опасность дублированного контента

Здесь можно назвать целый ряд неприятных последствий. Среди них

Неявные дубли могут стать причиной снижения общей уникальности текста на странице. Особенно это характерно для широко тиражируемого контента, например – новостей.

При отсутствии контроля за дублями, создаются дополнительные временные затраты при переобходе всех страниц. Дело в том, что у каждого краулера существует определенный лимит запросов к вашему домену. Вполне реальны случаи, когда краулер тратит все лимиты при обходе мусорных страниц, а до страниц с оригинальным контентом так и не добирается.

Что такое дубли

Дублями называют умышленно или случайно дублируемый на сайте контент. Дублем справедливо называть абсолютно любой повторяющийся (только на различающихся URL) контент. Естественно, речь о повторах на одном домене.

Почему появляются дубли

Самые частые причины дублирования контента:

Самая главная причина – это техническое несовершенство абсолютно всех CMS, которые автоматически генерят дубли во множестве ситуаций. Самый частый случай – соотнесение одной веб-страницы одновременно с двумя (и более, соответственно) рубриками на сайте.

Так могут выглядеть дубли, создаваемые системой управления контентом:

Именно сама CMS представляет наибольшую опасность, когда мы говорим об автогенерации URL и возникающим дублировании контента.

Дублями очень часто грешат и плагины для CMS, особенно – плагины для WordPress. Когда мы говорим о дублях в технических разделах сайта, то наиболее часто портачит Joomla и всеми любимый Bitrix. Указанные CMS автоматически создают ссылки, включающие специальные параметры. Особенно часто дубли формируются при регистрации, использовании поиска на сайте, фильтровании товаров, кастомизации карточек товаров, сортировке, пагинации.

Выглядят параметрические URL следующим образом:

Многие CMS также грешат зацикливанием URL, которое происходит автоматически. Большое количество таких ссылок затрудняет работу краулеров и негативно сказывается на индексации домена.

Вторая самая частая причина появления дублей – некорректные записи в системном файле robots.txt и ошибки в нем же.

Третья – некорректная настройка 301-го перенаправления.

Как найти дубли на своем сайте

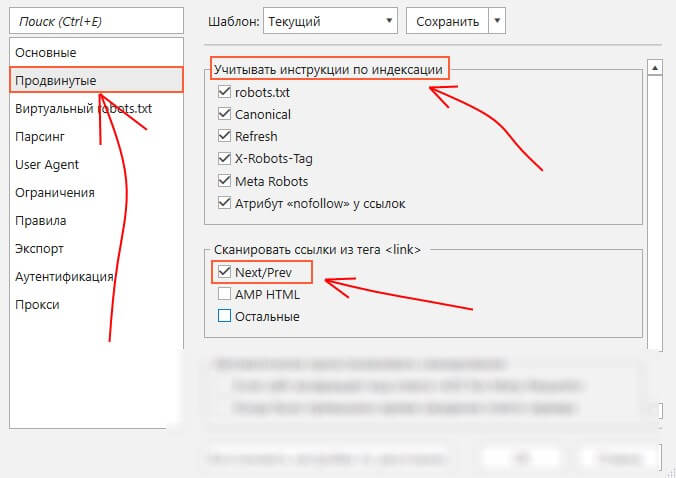

Для выявления дублированного контента на своих сайтах, я использую несколько инструментов. Вообще искать можно и вручную, но, если страниц много, то этот вариант трудно исполним. Гораздо легче находить дубли при помощи специализированных сервисов, таких как NetPeak Spider. Достаточно ввести домен в поисковой строке и выбрать пункт «Найти». Предварительно, откройте раздел с параметрами и отметьте следующие чекбоксы:

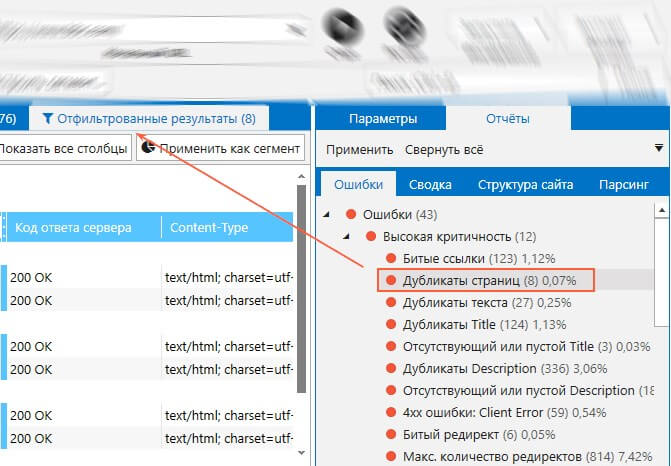

Теперь указываем домен своего сайта и выбираем пункт «Старт». После того как сканирование будет завершено, выбираем «Отфильтрованные результаты», открываем раздел «Отчеты» и в пункте «Ошибки» находим все интересующие нас дубли: страниц / текста / Title / Description:

Отмечу, что прорабатывать нужно только те дубли, которые отдают 200-ый код.

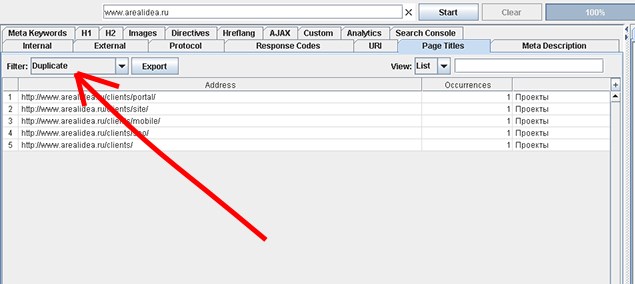

Также для автоматического поиска дублей можно использовать программу Screaming Frog SEO Spider: достаточно указать домен и запустить сканирование. В результатах поиска нужно выбрать пункт URL. Дублирование контента выводится в разделе Duplicate:

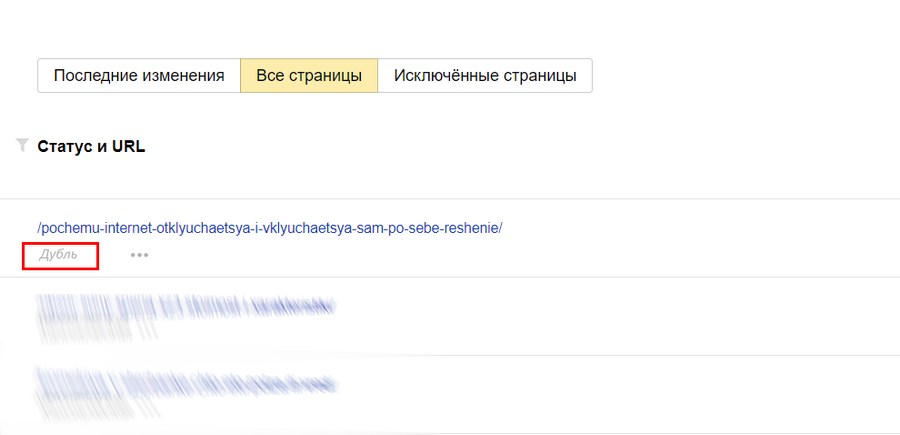

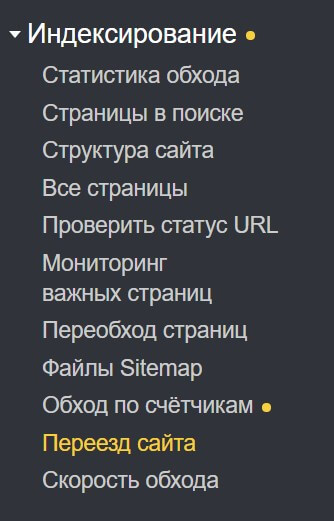

Ну и, конечно, дубли покажет «Яндекс.Вебмастер» и Google Search Console. В первом случае идем в пункт «Страницы в поиске», который находится в разделе «Индексирование». Теперь обращаем внимание на пункт «Статус и URL». Здесь будут отображаться все найденные дубли:

В GSC дублированный контент обнаружить не составит труда. Достаточно открыть раздел «Покрытие». Здесь обращаем внимание на пункт «Сведения» и в поле «Статус» смотрим лист исключенных URL.

Какие дубли встречаются наиболее часто

Все дубли можно усредненно разделить на очевидные и неочевидные. Начнем с последних.

Неочевидные дубли

Этот тип дублированного контента отличается тем, что на разных страницах, он располагается в произвольном порядке (но содержание самого контента остается идентичным).

Итак, мы поняли, что неочевидные дубли представляют из себя страницы с максимально идентичным или полностью повторным контентом. Рассмотрим три самых частых причины появления таких дублей подробнее.

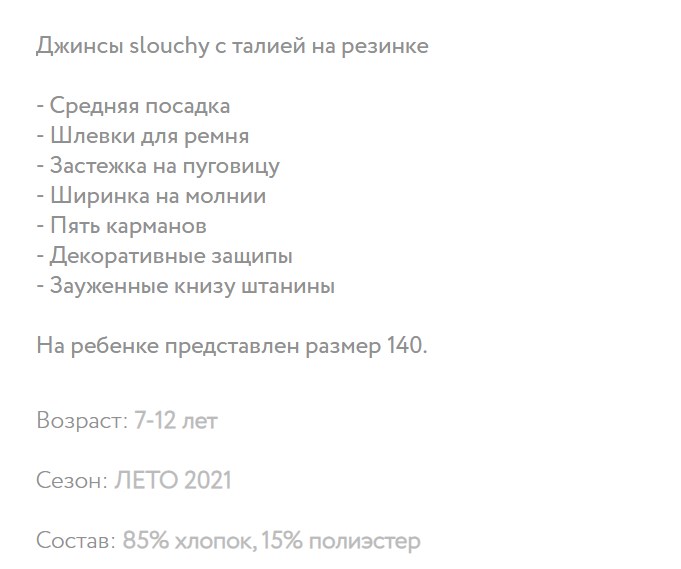

Товары с мало отличающимися / близкими характеристиками

У таких товаров, как правило, описание просто дублируется, либо частично отличается, например, дополнительным словом или небольшим предложением.

Попробую привести наглядный пример: магазин продает одежду, в карточке одного товара появляются вариации – размера или цвета, например. Практически одинаковые или схожие описания для разных товаров – это не очень хорошо:

Одно описание для разных размеров / цветов / вариантов:

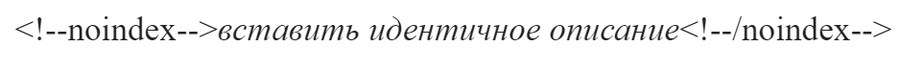

Краулер, с высокой долей вероятности, просто запутается – обойдет первую карточку товара, а схожие (с разными размерами, цветами, материалами) оставит без внимания. Решение простое: все повторяющиеся предложения (на страницах со схожим контентом) просто берем в следующий тег:

Подводные камни такого решения: данный тег учитывает только «Яндекс», кроме этого он не подходит для отличающихся характеристик товара.

Еще один вариант решения проблемы схожих описаний: использовать селектор, чтобы выбирать различные характеристики товара. CSS-селектор определяет с каким именно элементом соотносится выбранное CSS-правило. Предварительно нужно будет сгруппировать все схожие типы товаров, в рамках единой карточки, например, если мы говорим об интернет-магазине.

Третий вариант: все описания схожих предметов нужно сделать максимально уникальным. Если таких карточек слишком много, то начните с тех, которые приносят наиболее высокие конверсии. Например, уникализируйте описания футболок только красного цвета, а зеленые и розовые оставьте на потом, если их не покупают. В общем, правильно расставляйте приоритеты.

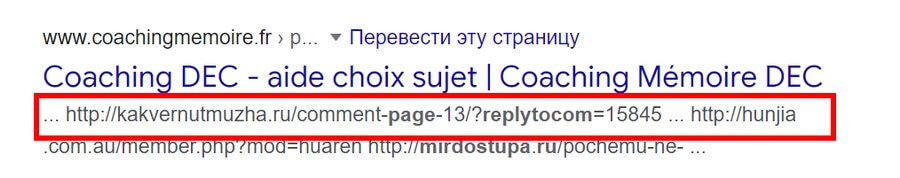

replytocom-комментарии

replytocom – это так называемые дублирующие древовидные комментарии. Отмечу, что данный пункт характерен исключительно для WordPress-сайтов. Выглядит replytocom следующим образом:

WordPress, таким образом, заново создает новый URL-адрес при ответе на каждый последующий комментарий на странице. Все это замедляет сайт, а краулеры также не прочь скушать такие URL. Потом такие дубли могут оказаться в SERP. Что делать? Установите Disqus или любой другой сторонний модуль комментариев на свой сайт. Стандартные комментарии в этом случае придется выключить.

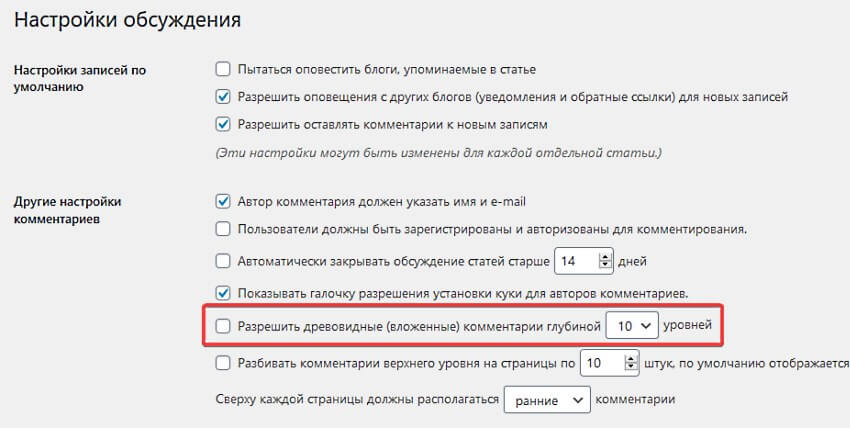

Другой способ решить проблему replytocom: открываем админку WordPress, затем идем в глобальные настройки и в пункте «Обсуждения» снимаем выделение с этого чекбокса:

Если по каким-то соображениям вы не хотите пользоваться сторонними модулями и отключать классические WP-комментарии на своем сайте, то есть варианты и посложнее. Но там уже придется кодить, поэтому описывать их в рамках этого материала не буду.

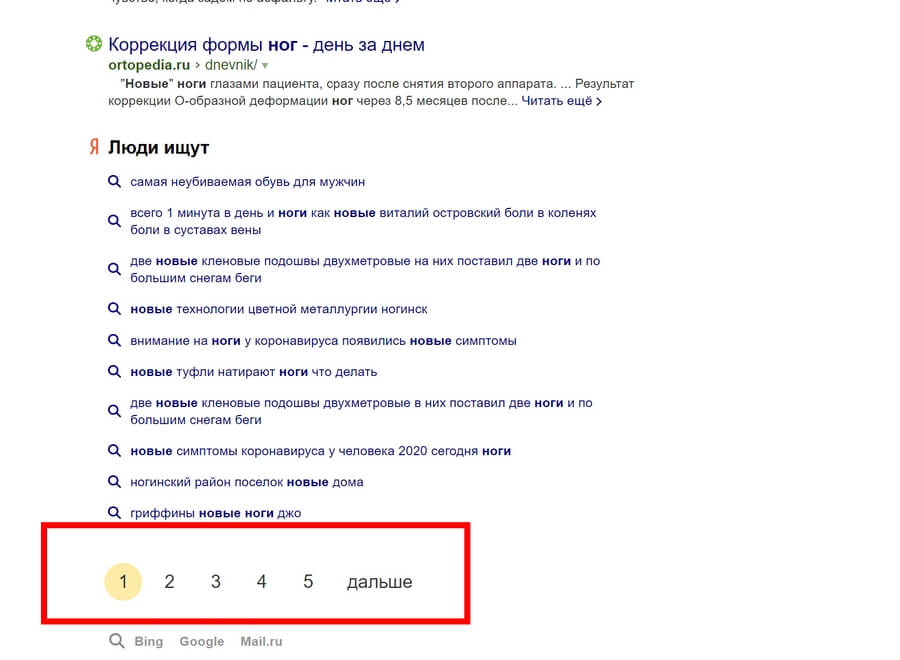

Пагинация

Любой каталог всегда разделяется на несколько страниц. Пагинация или листинг – это и есть страницы, которые мы переключаем, перемещаясь по ним:

Один из самых частых вариантов происхождения неявных дублей – это индексирование таких страниц пагинации. Чтобы краулеры не обходили их, необходимо добавить на все страницы пагинации следующий код код:

Добавление делаем исключительно в секции head-тега. Кстати, «Яндекс» рекомендует устанавливать rel=»canonical» со всех URL пагинации исключительно на главную (то есть первую): обратите внимание на второй пункт. Но добавив каноникал, вы не заставите краулеров «Яндекса» четко ему следовать – вы создаете не предписание, а лишь рекомендацию.

А вот Google вообще не рекомендует ставить каноникал со всех URL пагинации, иначе их краулер получит ошибку при очередном сканировании.

Google советует вообще не трогать страницы пагинации и просто сосредоточиться на «улучшении пользовательского опыта». Другими словами, использовать rel=»canonical» на страницах пагинации, если ваш сайт получает основной трафик из Google, вовсе не стоит.

Я предлагаю несколько лайфхаков, чтобы не наделать проблем со страницами листингов:

404-ая

Один из самых частых сценариев неочевидного дублирования – это некорректно настроенная 404-ая страница. В таких условиях, любая страница будет выводить одинаковый для всех шаблон, отдающий 200-ый код ответа сервера.

Обратите внимание на то, как именно настроена 404-ая на вашем сайте. Помните – чтобы избежать дублей 404-ой, необходимо обратить внимание на все проблемные страницы. Они должны отдавать исключительно 404-ый код.

Еще один вариант решения этой проблемы – просто настроить редирект на страницу с информацией, которую искал посетитель.

Очевидные дубли

Очевидные или явные дубли – это такие же страницы с идентичным содержимым, когда повторяется не только контент, но и порядок его расположения на странице. Здесь существует серия стандартных ошибок, приводящих к появлению дублированного контента. Рассмотрим их подробнее.

Страница для печати

Дам пример для наглядности:

Как видим из примера выше, дубли появляются в случае, когда печатная версия страницы на вашем сайте, генерируется при помощи функции ?print. Такая версия страницы печати – всегда дубль, так как ее содержимое полностью идентично оригинальной версии страницы.

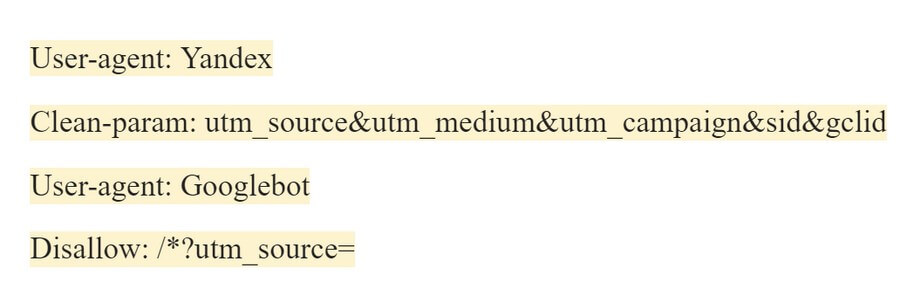

Решить проблему дубля печатной страницы можно при помощи уже знакомых нам директив: Clean-param и Disallow. Первую директиву понимает исключительно отечественный поисковик. Вторая создана специально для краулеров Google. Соответствующие директивы необходимо прописать роботс-файле. Например, так мы сделаем это для всех краулеров:

Вышеуказанное правило будет работать для всех поисковых систем. Если же вам нужно ограничить индексирование print-страниц только краулерам «Яндекса», то воспользуйтесь Clean-param, если только роботам Google – применяйте директиву Disallow.

Слэш после URL

Возможно, вы не обращали внимания, но на разных сайтах используется два типа адресов – с косой чертой в конце адреса и без нее. Выглядит это следующим образом:

Косая черта в конце адреса – одна из самых частых причин дублей. Решить эту проблему не сложнее, чем предыдущие – достаточно сделать 301-ое и перенаправление. О том, как именно это сделать, вы можете узнать в блоге TexTerra.

Что касается более предпочтительного варианта – оставлять все ссылки со слэшем в конце или без него, то здесь нужно смотреть на то, каких URL у вас на сайте было больше изначально. Если со слэшем – значит, оставляем URL со знаком / в конце, если наоборот – оставляет URL без /.

Один товар на разных URL (для интернет-магазинов)

Допустим, у нас интернет-магазин TexTerra, который продает технику Apple. Ссылки на одну модель «Айфона» могут иметь такой вид:

Решить эту проблему можно настроив каноникал на главную страницу. Здесь два способа.

Плагины

Управлять каноническими страницами, проще всего, при помощи плагинов для CMS. Например, у меня один из сайтов работает WP, и для назначения каноникал я использую плагин Yoast SEO. Там канонические страницы настраиваются в два-три клика. Допустим, нужно назначить каноникал в пагинации рубрик:

Специальный тегWWW в ссылках

По аналогии со слэшем, отличаться URL могут и по отсутствию или наличию «www» в начале адреса. На практике такой URL может выглядеть следующим образом:

Избавиться от дублей адресов по признаку наличия или отсутствия «www» можно несколькими способами. Для начала определитесь и укажите главное зеркало. В блоге есть целая статья на эту тему. Статья старая, но в целом актуальная. Единственное замечание – в роботс больше не нужно указывать host-директиву.

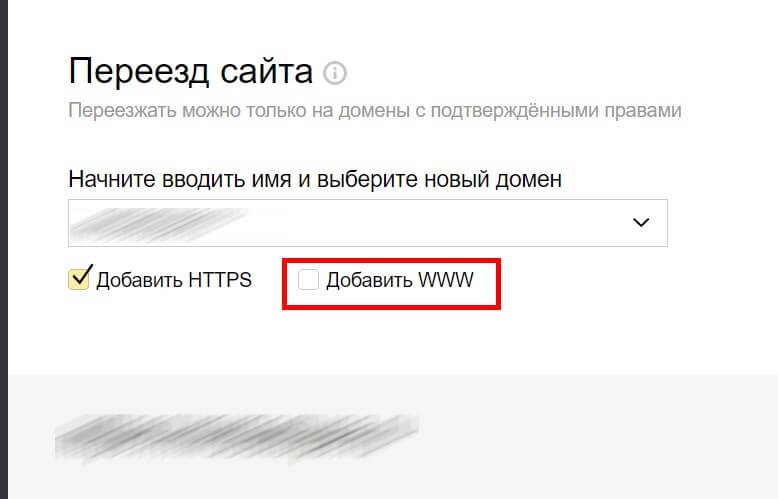

Как склеить зеркала в «Яндексе»

Если коротко, то просто откройте «Яндекс.Вебмастер» и убедитесь, что в разделе «Сайты» у вас добавлены обе версии домена – как без «www», так и с «www». На этом шаге нужно определиться какую версию домена мы будем считать главным зеркалом.

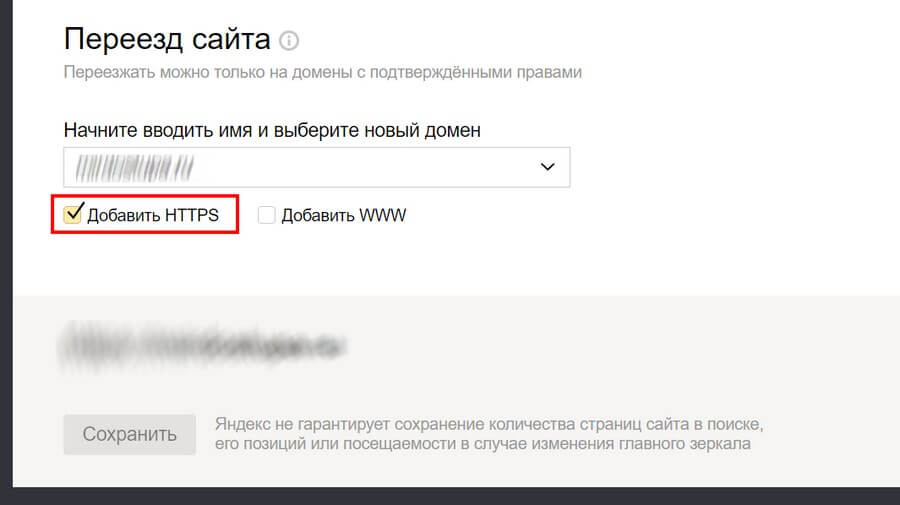

Теперь нужно выбрать тот домен, с которого должна происходить переадресация. Теперь выбираем этот домен в верхней части «Яндекс.Вебмастера» и в разделе «Индексирование» открываем пункт «Переезд сайта»:

Убираем выделение с этого чекбокса:

Как склеить зеркала в Google

Склеить зеркальные домены в Google чуть сложнее – нужно сделать 301-ое перенаправление на главное зеркало. О том, как это сделать, вы можете узнать в нашем блоге. Если способ с редиректом по каким-то причинам не подходит, то можно:

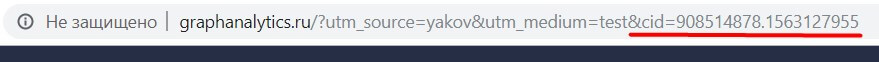

Параметры типа CGI

CGI-параметры в URL – еще одна причина массовых дублей. В данном случае имею в виду динамические параметры, которые изменяют содержимое страницы. Идентифицировать GET-параметры просто – достаточно найти знак «?» во второй части ссылки. Например:

Решить дубли, идущие от GET-параметров, можно одним рабочим способом – создать правила в robots. В него можно включить абсолютно любые типы параметров, например, UTM-разметку или разметку «Google Рекламы»:

Еще один способ – задействовать Clean-param. Но эту директиву, как я уже упомянул выше, поддерживает исключительно «Яндекс», поэтому рассматривать подробнее ее не буду. Хотя вы, конечно, можно использовать обе директивы в одном robots. Выглядеть такое правило будет следующим образом:

Тип протокола передачи гипертекста в URL

Речь об HTTPS-url и HTTP-url, соответственно.

Если же вы уже купили SSL-сертификат и переехали на HTTPS, наверняка, образовалось огромное количество дублированного контента. Ведь краулеры определяют домены https://www.texterra.ru и http://texterra.ru как совершенно разные. Отсюда и огромное количество дублей. Кстати, у нас есть большой материал по теме «Как переехать на HTTPS правильно» – обязательно прочитайте.

Чтобы решить проблему дублей после переезда на HTTPS-протокол, открываем «Яндекс.Вебмастер» и выбираем главный домен (главное зеркало). Для этого, в разделе «Переезд сайта» (напомню, он находится в разделе «Индексирование») отмечаем соответствующий чекбокс:

Внимание! Обязательно убедитесь в том, что все перенаправления работают корректно. Особенно тщательно проверяйте сами команды редиректов – часто ошибки кроются именно в них.

Послесловие. Работа с дублями Google и «Яндекс» – в чем разница

Мы убедились в том, что устранить дубли можно несколькими инструментами. Как обычно Google и «Яндекс» заметно различаются в своих инструкциях для вебмастеров. «Яндекс» рекомендует работать с дублями через файл robots и директиву Clean-param. Google же советует устранять повторы через 301-ое перенаправление и атрибут Canonical.

Что лучше? Здесь каждый владелец сайта должен сам выбрать наиболее оптимальный сценарий работы с дублями. Если основной трафик на ваш сайт идет из «Яндекс» – используйте директиву clean-param. Если трафик, в основном, из Google – используйте Canonical.

Не рекомендую слишком увлекаться перенаправлениями, так как они создают излишне высокую серверную нагрузку и другие проблемы, а еще затрудняют индексацию новых страниц.

В Google и «Яндексе», соцсетях, рассылках, на видеоплатформах, у блогеров